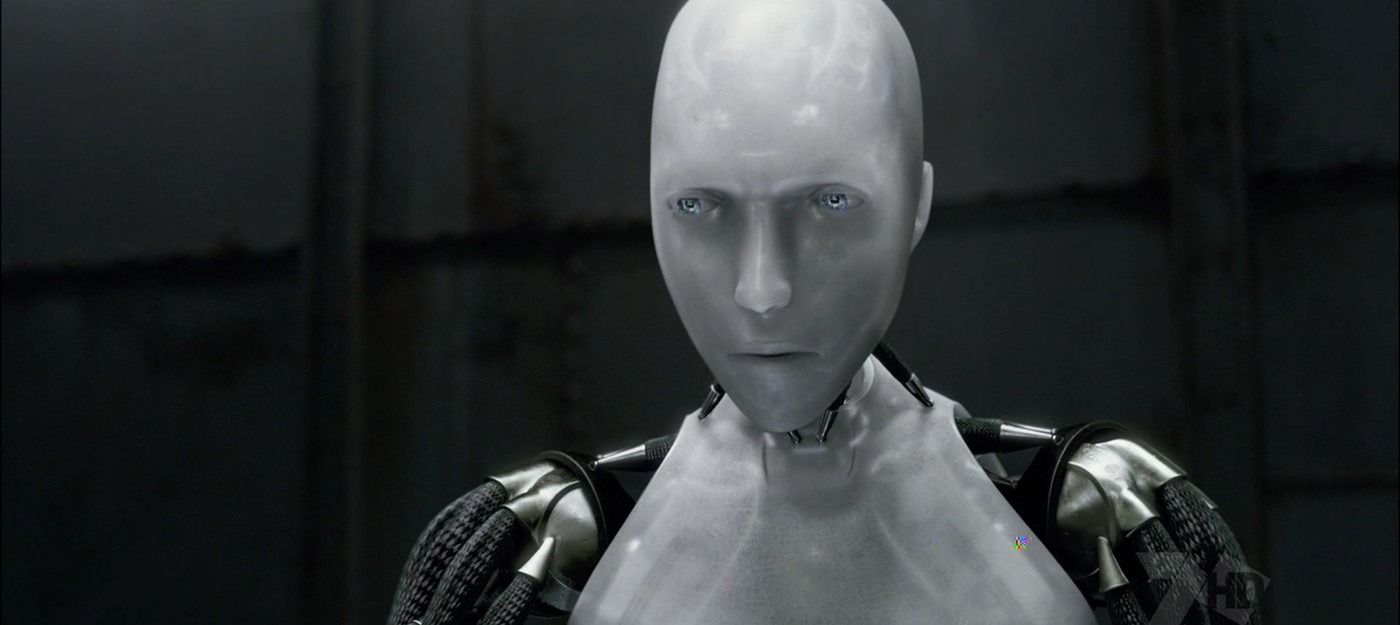

Community Call: или как решить проблему вагонетки, когда ты — бездушная машина

Чем еще можно заняться на работе? Правильно! Бездарно и бесцельно просиживать в интернете. Благо, что иногда всё-таки попадается что-то стоящее, что хоть как-то может оправдать потраченное время, пока ты тихо бубнишь себе под нос проклятия на голову начальнику за то, что он конечно же не по делу тебя раздолбал.

И вот сидя на одном вполне известном ресурсе, который я конечно же не назову, я наткнулся на пост о проблеме вагонетки. Вспомнив недавний забавный пост о двухлетнем мальчике и о том, как неожиданно он решил эту самую проблему вагонетки, я решил, что мне интересно, а как бы вы, шазувчане, поступили в подобной ситуации? И для этого я предлагаю пройти тест. Результаты теста позволяют сравнить решения принятые вами с решениями принятыми остальными опрошенными.

Данный тест был разработан студентами не чего-то там, а целого Массачусетского технологического университета, и направлен он на исследование проблемы принятия искусственным интеллектом нравственных решений. В частности речь идёт о модном ныне автопилоте.

Каждый из нас обладает волей, совестью, эмоциями, чувствами, характером и прочими атрибутами недоступными для ИИ. Мы можем оправдать свои поступки, но машина - нет. Решение принимаемое ИИ это лишь установка заложенная его создателями. (забавно, ведь получается, что ни о какой самостоятельности речь не идёт). Решение принимаемое роботом это лишь один из возможных вариантов развития событий, которое будет принято в результате исследования десятка переменных. Всё это произойдет за считанные секунды и естественно кому-то оно покажется неправильным.

Противники этих технологий будут трубить тревогу и пытаться запретить эти "машины смерти", ведь будь за рулём человек, он бы непременно принял действительное правильное решение...

Практически любое ДТП — это результат несоблюдения скоростного режима. Эта проблема, если мы говорим об ИИ, может быть искоренена вовсе. Но остаётся человеческий фактор. Риск поломки конструкции, сбоя программного обеспечения, которые просто не позволят ИИ реализовать свой потенциал. И что тогда?

Я предпочту спасти ребёнка, пожертвовав несколькими пожилыми людьми сидящими в машине, даже если первый будет переходить дрогу в неположенном месте. Но это мой выбор. А в память робота будут заложены ПДД, которые он будет вынужден неукоснительно соблюдать.

Скидывайте свои результаты в комментарии, вместе со своим мнением о данной проблеме. Ну и конечно же не забывайте о манерах ;)

Ниже делюсь своими результатами.

- Нобелевскую премию по физике получили "крестные отцы" ИИ

- ИИ может быть причиной, почему мы не можем найти инопланетные цивилизации

- Почему опасно сваливать все жизненные решения на ИИ — это ведет к антиутопии