OpenAI изучает возможность добавления водяных знаков в ChatGPT для выявления читеров

OpenAI подтвердила, что исследует технологию водяных знаков для текстов, сгенерированных ChatGPT. Это может помочь выявить случаи мошенничества среди студентов.

По данным The Wall Street Journal, компания уже разработала инструмент, способный с высокой точностью определять тексты, написанные ChatGPT. Однако обсуждение о целесообразности его выпуска пока не позволили ему увидеть свет.

Компания отметила, что водяные знаки — лишь один из нескольких вариантов решения проблемы определения происхождения текста. Другие методы включают классификаторы и метаданные.

По словам OpenAI, технология водяных знаков показала высокую точность в определенных ситуациях. Однако ее эффективность снижается при некоторых видах модификации текста, например, при использовании систем перевода или перефразировании с помощью другой генеративной модели.

Кроме того, в компании обеспокоены тем, что использование водяных знаков может непропорционально повлиять на некоторые группы пользователей. В частности, это может стигматизировать использование ИИ как полезного инструмента для написания текстов людьми, для которых английский не родной язык.

OpenAI взвешивает все риски, связанные с внедрением этой технологии. При этом компания отдает приоритет разработке инструментов аутентификации для аудиовизуального контента.

- В ChatGPT открыт бесплатный доступ к улучшенному генератору изображений

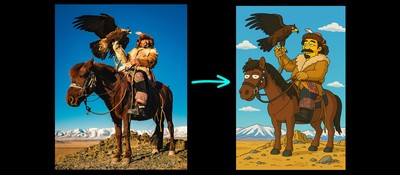

- Как превратить ваши фотографии в персонажей из Симпсонов или аниме Ghibli при помощи ChatGPT

- OpenAI откладывает запуск генератора изображений ChatGPT для бесплатных пользователей

0 комментариев